Od veľkých dát k presnej AI: Sprievodca pre pokročilých

Vítame vás v sprievodcovi na tému "Od veľkých dát k presnej AI," ktorý je určený pre pokročilých a zvedavých programátorov. Doba, v ktorej žijeme, je charakterizovaná ohromujúcim nárastom dát, ktoré sa generujú každý deň. Otázkou však zostáva, ako tieto dáta efektívne využiť na tvorbu presnej a funkčnej umelé inteligencie. V nasledujúcich úryvkoch sa pozrieme na kľúčové aspekty prípravy a spracovania veľkých dát pre AI. Ide o proces, ktorý nielenže zvyšuje presnosť modelov, ale poskytuje aj konkurenčnú výhodu v modernom technologickom svete.

Úloha veľkých dát v AI

Veľké dáta, známe tiež ako Big Data, predstavujú rozsiahle množiny údajov, ktoré sa neustále menia a vyžadujú špeciálne techniky pre ich spracovanie. V kontexte AI slúžia veľké dáta ako základný stavebný kameň pre učenie sa modelov. Čím viac dát model spracováva, tým presnejšie predikcie dokáže robiť. Preto je nevyhnutné zamerať sa na ich zber, ukladanie a analýzu. Takéto prístupy umožňujú AI systému lepšie porozumieť komplexným vzorom a vzťahom v reálnom čase.

Zber a príprava dát

Zber a následná príprava dát je prvou kľúčovou etapou. Je nutné zabezpečiť, aby dáta boli kvalitné, relevantné a dostatočne rozsiahle. K tomu často slúži ETL proces (Extract, Transform, Load), ktorý zahŕňa extrakciu dát z rôznych zdrojov, ich transformáciu do použiteľného formátu a následné nahratie do dátových skladov. Kvalita dát ovplyvňuje nielen presnosť, ale aj interpretovateľnosť AI modelov. Preto je dôležité ošetriť problémy ako chybové údaje, duplicity a iné anomálie ešte pred samotným použitím dát.

Nástroje pre zber dát

- Apache Hadoop - robustná platforma pre distribuované úložisko a spracovanie veľkých dát

- Apache Spark - nástroj pre rýchle spracovanie dát cez paralelné úlohy

- Panďas - knižnica v Pythonu na čistenie a analýzu dát

Analýza a modelovanie dát

Po úspešnej príprave dát nasleduje ich analýza a modelovanie. V tejto fáze sa využívajú rôzne algoritmy strojového učenia, ako sú rozhodovacie stromy, neuronové siete alebo podporné vektorové stroje. Výber správneho algoritmu závisí na povahe problému a dostupných dátach. Kľúčovou úlohou je tu odhaliť skryté vzory a súvislosti v dátach, ktoré môžu byť použité pre prediktívne modelovanie. Výsledkom tejto fázy je model, ktorý dokáže generovať presné predikcie na základe učenia sa z dát.

Implementácia a nasadenie AI modelov

Úspešné dokončenie modelu je len časťou prác. Rovnako dôležitá je aj jeho implementácia a nasadenie do produkčného prostredia. Tento proces zahŕňa integráciu modelu do súčasných systémov a aplikácií, čo môže zahŕňať jeho testovanie v reálnych podmienkach. Nasadenie umožňuje organizáciám ťažiť z modelov AI tým, že poskytujú výsledky, ktoré pomáhajú pri rozhodovaní v reálnom čase, a maximalizujú efektivitu operácií.

Optimalizácia a údržba AI modelov

Po nasadení modelu je potrebné zamerať sa na jeho optimalizáciu a údržbu. AI modely sa musia pravidelne rekalibrovať, aby zostali presné a relevantné. Techniky ako gradientný klesajúci algoritmus alebo regularizácia môžu byť použité na zníženie chybovosti a zlepšenie výkonnosti modelov. Neustála sledovateľnosť a aktualizácia modelov zabezpečuje, že AI poskytuje konzistentné a presné výstupy v dynamicky sa meniacom prostredí.

Časté otázky (FAQ)

- Čo sú veľké dáta a prečo sú dôležité pre AI?

Veľké dáta sú rozsiahle množiny údajov, ktoré sú kľúčové pre tréning AI modelov, pretože umožňujú poskytnúť bohatý základ pre ich učenie a zlepšenie presnosti predikcií.

- Aké kroky sú dôležité pri príprave dát pre AI?

Najdôležitejšie kroky sú zber kvalitných dát, ich čistenie od chýb alebo duplicít a transformácia do použiteľného formátu, aby modely AI mohli efektívne využívať tieto informácie.

- Aké nástroje môžem použiť pre spracovanie veľkých dát?

Medzi populárne nástroje patrí Apache Hadoop, Apache Spark a Python knižnice ako Panďas, ktoré pomáhajú pri efektívnom spracovaní a analýze veľkých dát.

- Prečo je dôležitá optimalizácia AI modelov?

Optimalizácia zabezpečuje, aby AI modely zostali presné a efektívne aj v meniacich sa podmienkach, čím maximalizujú hodnotu pre organizáciu.

- Ako sa implementuje AI model do reálneho prostredia?

Implementácia zahŕňa integráciu modelu do súčasných IT systémov, jeho testovanie a zabezpečenie, že operuje podľa očakávaní v reálnych podmienkach.

Top 5 faktov o veľkých dátach a AI

- Veľké dáta hrajú kľúčovú úlohu v presnosti AI modelov, čím lepšie sú spracované, tým presnejšie výsledky generujú.

- Spracovanie veľkých dát umožňuje AI systémom analyzovať a porozumieť zložitým vzorom, ktoré by tradičné systémy neodhalili.

- Rôzne odvetvia ako zdravotníctvo, financie alebo doprava využívajú veľké dáta na vylepšenie AI aplikácií a služieb.

- Vývoj a nasadenie AI modelov môže priniesť konkurenčnú výhodu prostredníctvom automatizovania rozhodovacích procesov.

- Moderné nástroje a technológie ako cloud computing umožňujú efektívne ukladanie a spracovanie obrovských dátových množín.

Záver

Na základe tohto sprievodcu sme sa zoznámili s kľúčovými krokmi a nástrojmi na efektívne spracovanie veľkých dát pre presnú AI. Správnym využitím týchto techník môže každý programátor alebo organizácia výrazne zlepšiť schopnosti svojich AI modelov a získať významnú konkurenčnú výhodu. Pozývame vás objaviť ďalšie kurzy a zdroje, ktoré vám pomôžu plne využiť potenciál umelé inteligencie vo vašich vlastných projektoch.

Viac informacií preberáme na kurze:

Kurz AI - Praktický úvod do umelej inteligencie (AI) bez predchádzajúcich znalostí

Súvisiace články:

- Využite potenciál AI: Pokročilé techniky pre profesionálov

- AI riešenia pre rôzne odvetvia: Od marketingu po zdravotníctvo

- Inovatívne techniky prípravy dát pre AI modely

- Využitie neurónových sietí v reálnych projektoch

- Optimalizácia AI modelov: Zlepšite svoju presnosť

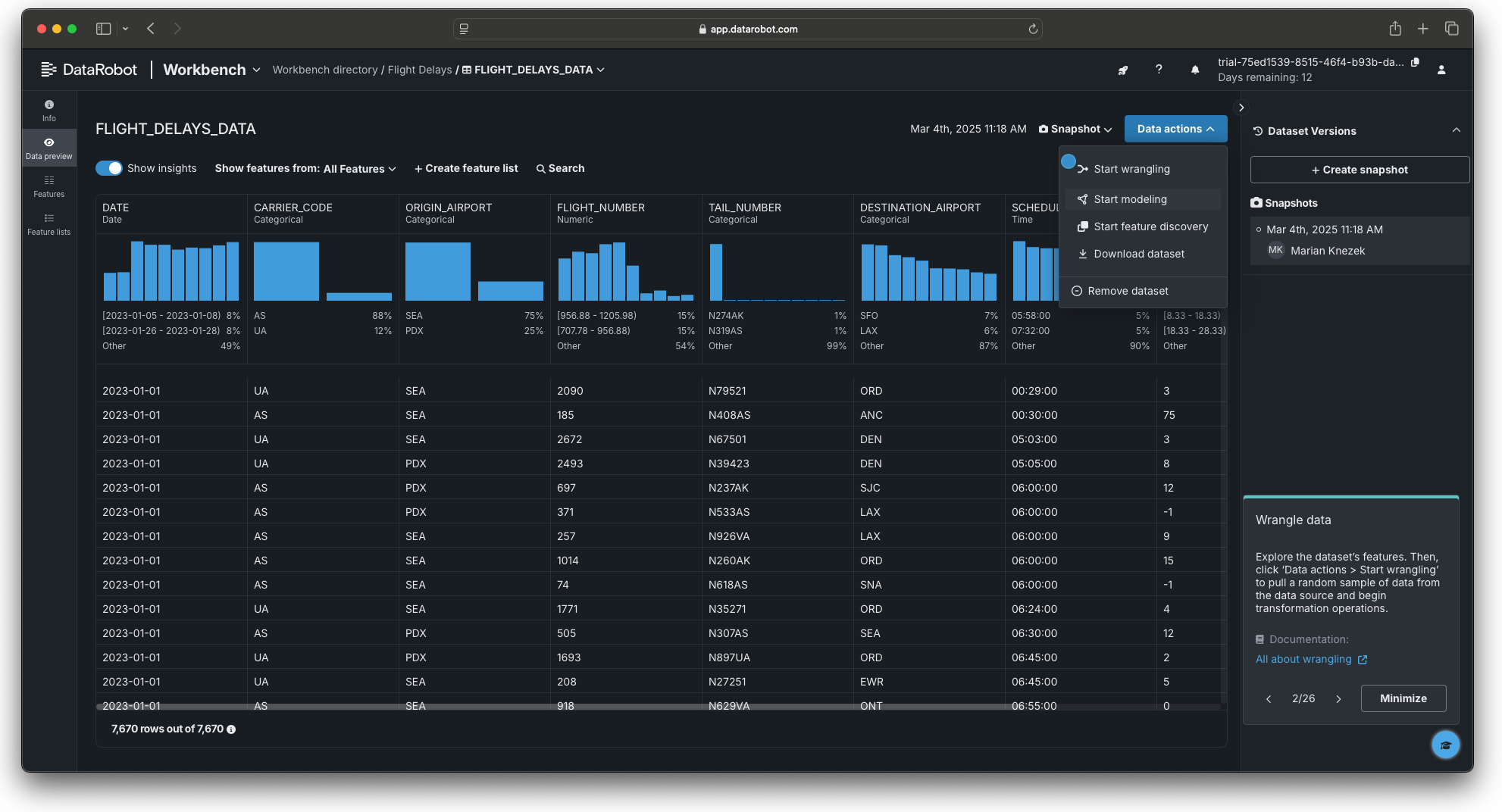

- Ako začať s AI bez programovania: Zažite revolúciu s DataRobot

- Google Colab: Váš sprievodca trénovaním AI modelov online