Inovatívne techniky prípravy dát pre AI modely

V dnešnej dobe, keď sa umelá inteligencia (AI) rýchlo rozvíja a stáva sa súčasťou mnohých odvetví, je nevyhnutné venovať osobitnú pozornosť príprave dát pre AI modely. Správne a efektívne spracované dáta môžu výrazne zlepšiť presnosť a výkonnosť vašich modelov. Táto téma sa stala predmetom veľkého záujmu najmä v kontexte pokročilých metód a nástrojov, ktoré nám umožňujú s dátami pracovať efektívnejšie ako kedykoľvek predtým.

Prečo je dôležitá príprava dát?

Príprava dát predstavuje kľúčový krok v procese vývoja AI modelov, ktorý má priamy dopad na výslednú kvalitu a presnosť modelu. Pod dohľadom odborníkov sa ukázalo, že zle pripravené dáta môžu viesť k nepresným predikciám a chybným výsledkom. Proces prípravy zahŕňa zber, čistenie, transformáciu a integráciu dát do formátu vhodného na tréning modelu. Každý z týchto krokov je kritický a môže ovplyvniť výkon modelu rôznymi spôsobmi.

Kroky prípravy dát

Zber dát

- Zber dát je prvotným a zásadným krokom, pri ktorom je dôležité získať dostatok kvalitných dát z rôznych zdrojov.

- Odporúča sa využívať rôznorodé zdroje, ako sú senzory, webové stránky, alebo databázy, aby sa zabezpečila variabilita.

- Začnite tým, že určíte, aké dáta sú pre váš projekt najlepšie a akým spôsobom ich získate.

- Dôkladne zvážte legálny a etický aspekt zberu dát, aby ste sa vyhli potenciálnym problémom.

- V tejto fáze môžete využiť nástroje ako Python alebo Apache NiFi na zjednodušenie zberu a uloženia dát.

Čistenie dát

Čistenie dát je proces, kde odstraňujeme chyby alebo nekonzistencie z dátových súborov. Nespracované dáta často obsahujú chýbajúce hodnoty, duplikáty či nezrozumiteľné znaky. Napríklad, ak máte dataset obsahujúci záznamy o zákazníkoch, odstránenie duplicitných záznamov a riešenie chýbajúcich údajov (napr. doplnením priemernej hodnoty) môže významne zlepšiť kvalitu dát. Na tento účel sa často používajú knižnice ako pandas pre Python, ktoré umožňujú efektívne a rýchle zmeny v dátach.

Transformácia a integrácia dát

- Mnohí odborníci považujú transformáciu za nevyhnutný krok, kde je potrebné dátové súbory prispôsobiť tak, aby boli využiteľné pre konkrétny model strojového učenia.

- Konverzia kategórií do číselných hodnôt je jedným z bežných krokov v tejto fáze, napríklad pomocou One-Hot Encoding.

- Integrácia dát spočíva v spojení viacerých datasetov do jedného koherentného súboru, ktorý bude schopný poskytnúť čo najkomplexnejšie výsledky.

- Na tento proces sa často využívajú nástroje ako TensorFlow alebo Keras, ktoré majú vstavané funkcie na predprípravu dát.

- Správna transformácia dát môže zásadne ovplyvniť schopnosť modelu identifikovať vzorce a variability v dátach.

Reálne príklady z praxe

Aby sme lepšie pochopili, ako príprava dát ovplyvňuje modelovanie, pozrime sa na príklad zo zdravotníctva. Predstavte si, že máte k dispozícii veľký dataset z rôznych nemocníc zahrňujúci zdravotné záznamy pacientov. Každá nemocnica môže mať odlišný spôsob zaznamenávania údajov, čo si vyžaduje dôslednú integráciu a normalizáciu dát. Po úspešnej príprave dát je možné vytvárať modely, ktoré dokážu predikovať pacientove výsledky alebo úspešnosť liečby. Podobne v oblasti financií, správne pripravené dáta môžu umožniť modelom presnejšie predpovedať trhové trendy či odhaliť podvodné transakcie.

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

# Načítanie dát

data = pd.read_csv('medical_records.csv')

# Čistenie dát

data.dropna(inplace=True)

data.drop_duplicates(inplace=True)

# Transformácia dát

features = pd.get_dummies(data[['sex', 'age', 'height', 'weight']])

target = data['disease']

# Rozdelenie na tréningovú a testovaciu množinu

X_train, X_test, y_train, y_test = train_test_split(features, target, test_size=0.2, random_state=42)

# Normalizácia dát

scaler = StandardScaler()

X_train_scaled = scaler.fit_transform(X_train)

X_test_scaled = scaler.transform(X_test)

FAQ

Prečo je dôležité čistiť dáta?

Čistenie dát odstraňuje nekvalitné či nekompletné záznamy, čo zvyšuje presnosť výsledkov modelu. Chyby, ako sú chýbajúce hodnoty či duplikáty, môžu výrazne skresliť výsledky akejkoľvek analýzy.

Aké sú najbežnejšie nástroje na prípravu dát?

Najpoužívanejšie nástroje zahŕňajú Python knižnice ako pandas na čistenie a transformáciu dát, scikit-learn na rozdelenie a škálovanie a nástroje ako Apache Spark pre spracovanie veľkých dátových objemov.

Ako zvoliť vhodný formát dát pre AI model?

Výber formátu závisí od typu modelu, ktorý chcete použiť. Niektoré modely pracujú lepšie s určitými formátmi, ako sú binárne alebo textové, a preto je kľúčové testovať a vybrať najvhodnejší formát pre konkrétny prípad.

Čo robiť, ak mám veľmi nehomogénne dátové sety?

V takýchto prípadoch je dobré siahnuť po metodikách ako PCA na redukciu dimenzionality alebo skúmať techniky vizualizácie dát na získanie lepšej perspektívy pred integráciou.

Ako zaistiť legálnosť zberu dát?

Dôležité je začať so štúdiom regulácií ako GDPR alebo HIPAA, získať povolenia a používať anonymizáciu dát, aby nedošlo k neočakávanému porušeniu predpisov.

Top 5 faktov o príprave dát pre AI

- 80% času pri práci s AI sa často trávi prípravou a čistením dát.

- Správne pripravené dáta môžu zlepšiť presnosť modelu až o 25%.

- Automatizované nástroje na prípravu dát začínajú nahrádzať manuálne postupy, čo zlepšuje efektivitu.

- Data-centric AI prístupy sú čoraz populárnejšie, sústredia sa na kvalitu a reprezentatívnosť dát.

- Zlé dáta môžu viesť k fatálnym chybám v modeloch a ohroziť ich prijatie a integritu.

Záver

Dôležitosť správne pripravených dát pre efektívne nasadenie AI modelov je nezpochybniteľná. Každý krok, od zberu až po transformáciu, prispieva k celkovej kvalite a výkonu výsledného modelu. Preto by sa malo investovať dostatok času a použití najlepších praktík na prípravu dát. Ak chcete začať testovať rôzne techniky alebo potrebujete radu, neváhajte sa pridať k našim kurzom AI, kde vám radi pomôžeme na ceste k pochopeniu a implementácii týchto techník.

Viac informacií preberáme na kurze:

Kurz AI - Praktický úvod do umelej inteligencie (AI) bez predchádzajúcich znalostí

Súvisiace články:

- Využitie neurónových sietí v reálnych projektoch

- Optimalizácia AI modelov: Zlepšite svoju presnosť

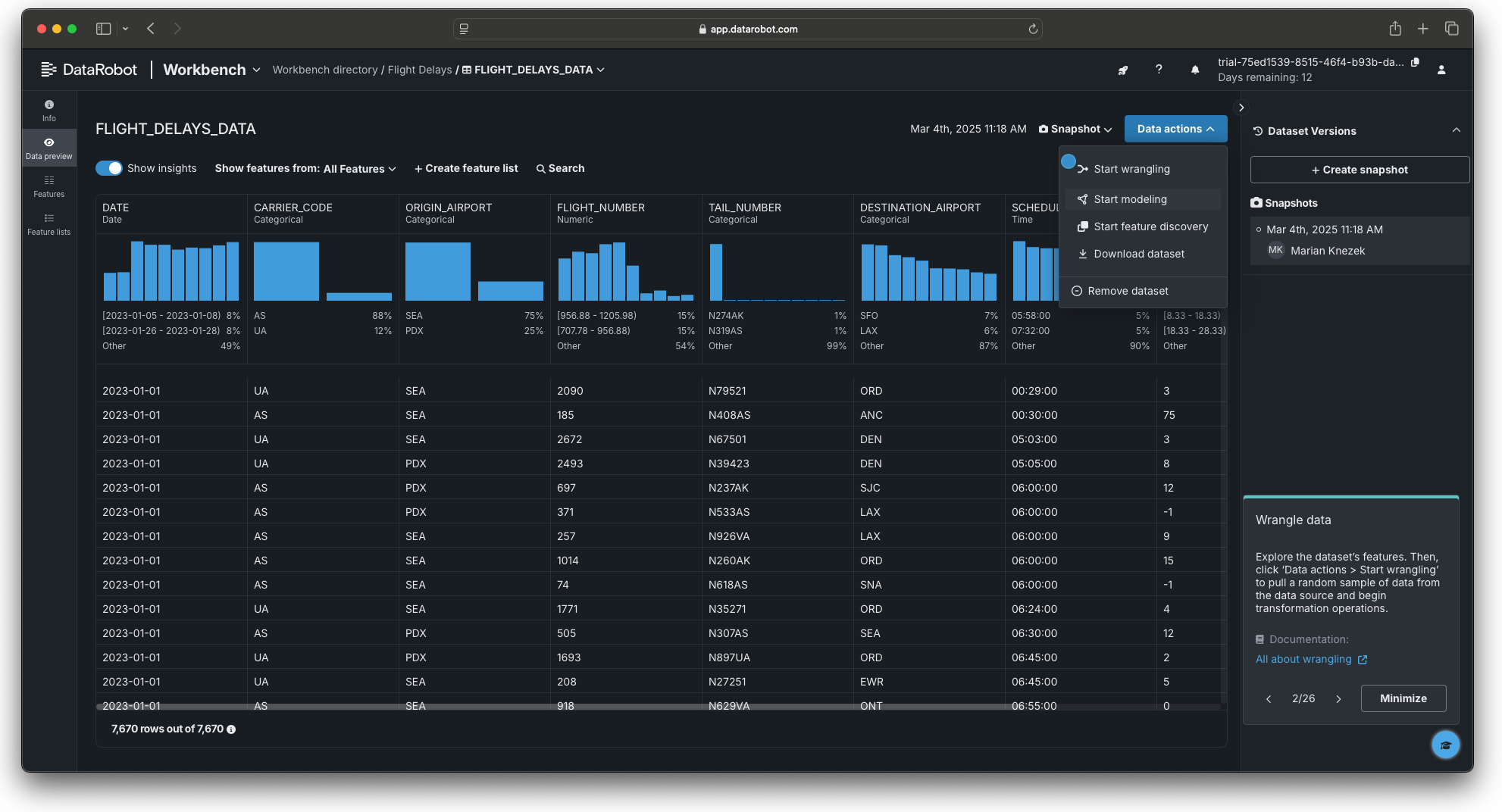

- Ako začať s AI bez programovania: Zažite revolúciu s DataRobot

- Google Colab: Váš sprievodca trénovaním AI modelov online

- AI v AWS: Prečo je to vaša najlepšia voľba pre škálovateľné riešenia

- Ako začať s AI a neminúť ani cent na drahú infraštruktúru

- Ako použiť OpenAI na tvorbu textov, nápadov a analýz bez skúseností